No Reino Unido, a lei já criminaliza a posse de conteúdo sexual gerado por Inteligência Artificial que envolva menores de idade.

O governo britânico está sendo pressionado a agir contra aplicativos que usam inteligência artificial para criar imagens falsas de nudez. A iniciativa é liderada pelo comissário da infância da Inglaterra, que defende a proibição dessas ferramentas para proteger crianças e adolescentes.

- Fique por dentro:

- Operação policial encerra plataforma ilegal de conteúdo infantil

- Europol emite alerta sobre crimes impulsionados por IA

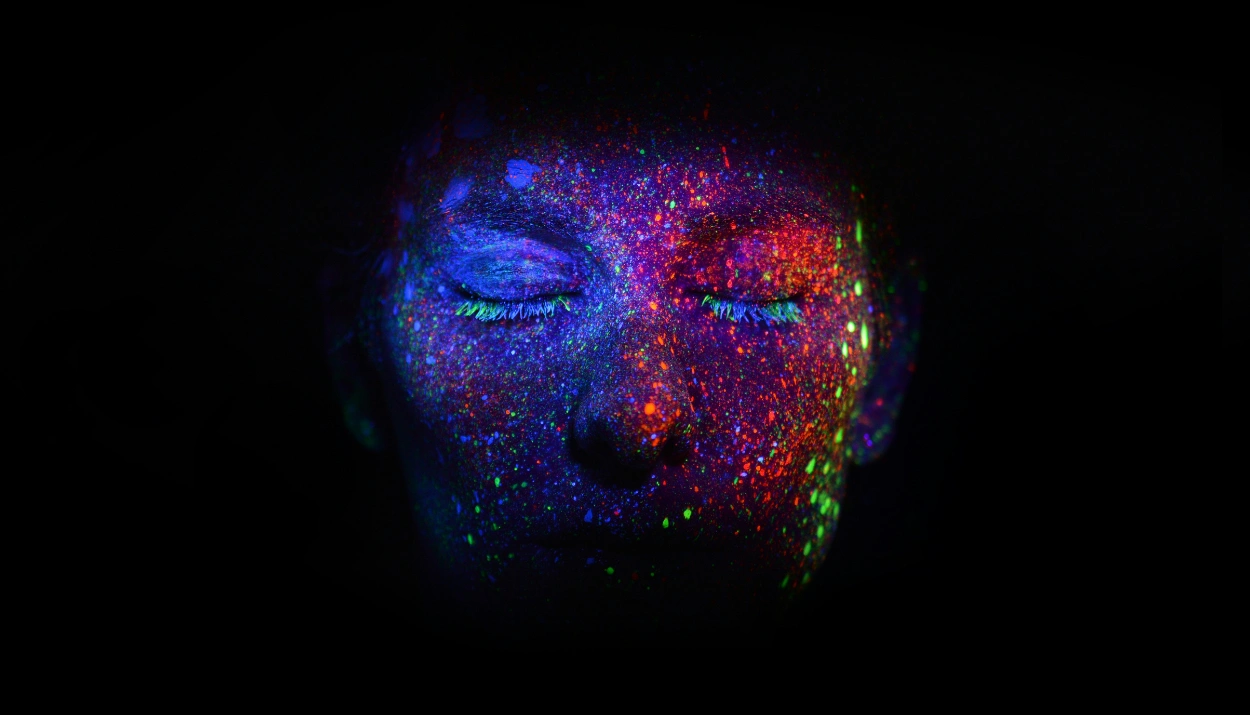

Nos últimos anos, softwares de “nudificação” (deepfake) alimentados por IA se tornaram populares e fáceis de acessar. Esses aplicativos conseguem, por exemplo, remover digitalmente roupas de fotos reais, gerar movimentos sugestivos ou até sobrepor rostos em corpos nus, produzindo resultados extremamente realistas.

Essa tecnologia, geralmente, se baseia em grandes bases de dados de imagens — compostas, na maioria dos casos, por imagens femininas — o que explica porque cerca de 99% dos deepfakes sexuais na internet são de mulheres e meninas. No Reino Unido, a lei já criminaliza a posse de conteúdo sexual gerado por IA que envolva menores de idade. Porém, o desenvolvimento dos modelos de inteligência artificial que criam esse tipo de material ainda não é regulamentado no país.

Propostas para barrar os apps de nudificação

O comissário propõe que o governo crie novas leis específicas ou ajuste legislações existentes. Uma opção seria incluir o tema no projeto de lei de segurança de produtos e metrologia, obrigando os desenvolvedores de IA a fazer avaliações de risco para atividades ilegais e a eliminar potenciais abusos antes que seus produtos cheguem ao mercado.

Se a regra entrar em vigor, aplicativos e sites de nudificação que não forem considerados seguros não poderão ser disponibilizados no Reino Unido.

Outra alternativa da proposta seria a apresentação de um projeto de lei de IA. Essa legislação tornaria as empresas de tecnologia responsáveis por prevenir o uso de suas ferramentas para criar imagens de crianças em situações de nudez. As empresas teriam de testar seus sistemas antes do lançamento e poderiam ser punidas caso suas ferramentas fossem utilizadas de maneira ilícita.

Contudo, a proposta não é unânime. A advogada Danielle Reece-Greenhalgh, do escritório Corker Binning, alerta que proibir essas ferramentas pode gerar controvérsias sobre a liberdade na internet. Ela também ressalta que, com o avanço da tecnologia, distinguir entre imagens reais e fabricadas por IA será cada vez mais difícil — o que pode complicar a aplicação da lei.